Algorithmische Systeme sind längst in unserem Alltag angekommen: Sie bestimmen für und über uns, indem sie Bewerbungen filtern, Krankheitsdiagnosen stellen oder die Kreditwürdigkeit analysieren. Deshalb müssen wir darüber diskutieren, wie der Einsatz dieser Technologie uns allen mehr Chancen als Risiken eröffnen kann. Wir sind überzeugt, dass dafür die Gestaltung der algorithmischen Systeme bestimmten Regeln folgen muss. Unser Vorschlag für einen solchen Regelkatalog sind die Algo.Rules. Unser Ziel ist es, dass die Algo.Rules in der Entwicklung aller relevanten algorithmischen Systeme angewendet werden.

Das Projekt „Ethik der Algorithmen” der Bertelsmann Stiftung hat den Prozess zur Erarbeitung der Algo.Rules initiiert. Wir wollen zu einer Gestaltung algorithmischer Systeme beitragen, die zu mehr Teilhabe für alle führt. Nicht das technisch Mögliche, sondern das gesellschaftlich Sinnvolle muss Leitbild sein. Denn das übergeordnete Ziel unserer Stiftungsarbeit ist es, den digitalen Wandel in den Dienst der Gesellschaft zu stellen. Wir wollen zivilgesellschaftliche Stimmen stärken, Brücken zwischen verschiedenen Disziplinen, der Wissenschaft und Praxis bauen und proaktiv Lösungen entwickeln. Die Erarbeitung von Regeln für die Gestaltung algorithmischer Systeme halten wir für einen von vielen vielversprechenden Lösungsansätzen, die in ihrem Zusammenwirken dazu beitragen können, dass Algorithmen dem Gemeinwohl dienen. Der unabhängige Think Tank iRights.Lab wurde mit der Organisation dieses Entwicklungsprozesses beauftragt. Das iRights.Lab hat langjährige Erfahrung darin, transdisziplinär komplexe Strukturen und Systeme gemeinsam mit einem diversen Netzwerk zu entwickeln und für die Praxis relevant zu machen. Gemeinsam wollen wir eine gesellschaftliche Debatte anstoßen und zur gesellschaftlichen Weiterentwicklung in diesem Bereich beitragen.

Die Algo.Rules sind in einem interdisziplinären, multisektoralen und offenen Prozess entstanden. Wir arbeiten interdisziplinär, weil die Wirkung algorithmischer Systeme nur durch ein Zusammenkommen verschiedener Perspektiven verstanden werden kann. Wir beziehen verschiedene Sektoren ein, weil Akteur:innen aus Wissenschaft, Gesellschaft, Politik und Wirtschaft verstärkt miteinander ins Gespräch kommen sollten. Unser Ansatz ist zudem grundsätzlich offen gewählt, weil die Zukunft unserer digitalisierten Gesellschaft uns alle angeht.

Der Prozess startete durch einen Workshop im Mai 2018. Im Rahmen zweier Studien (zu den Erfolgsfaktoren von Professionsethiken sowie den Stärken und Schwächen bestehender Gütekriterienkataloge für den Algorithmeneinsatz) sowie der Betrachtung einer Vielzahl anderer bestehender Regelkataloge für algorithmische Systeme wurden theoretische Grundlagen für die Algo.Rules gelegt. Parallel wurden im Sommer 2018 40 Expert:innen aus Politik, Wirtschaft, Zivilgesellschaft und Wissenschaft zu dem damaligen Entwurf konsultiert und um intensives Feedback gebeten. Ein weiterer Workshop im Herbst 2018 stellte Überlegungen zur Implementierung der Algo.Rules an. Ende des Jahres wurde die breite Öffentlichkeit im Rahmen eines Online-Beteiligungsprozesses dazu aufgerufen, sich zu beteiligen und Ideen beizusteuern. Nach Auswertung dieses Prozesses wurden im März 2019 die Algo.Rules im Rahmen einer Pressekonferenz veröffentlicht.

Im Anschluss arbeiteten wir daran, die Algo.Rules für zwei sogenannte Zielgruppen zu spezifizieren: Entwickler:innen und Führungskräfte. Dazu fanden im Laufe des Jahres 2019 zwei Workshops sowie zahlreiche Konsultationen mit Expert:innen aus der Praxis statt. Der daraus entstandene Leitfaden gibt Hinweise, wie jede der Algo.Rules praktisch umgesetzt werden kann. Ein Impulspapier beschreibt, welche Rolle Führungskräfte dabei einnehmen. Beide Dokumente wurden im Juni 2020 veröffentlicht.

Die Algo.Rules stehen nicht alleine, sondern reihen sich ein in die Gruppe an Initiativen, die eine gemeinwohlorientierte Gestaltung algorithmischer Systeme fördern wollen. Um hier einen Austausch zu starten, organisierten wir einen Workshop mit Expert:innen aus ganz Europa.

Um die Algo.Rules auch darüber hinaus in die Praxis zu tragen, beteiligten wir uns an der Entwicklung eines KI-Ethik-Labels. Als Teil der AI Ethics Impact Group entwickelten wir einen Vorschlag, der dabei helfen soll, allgemeine KI-Ethikprinzipien in die Praxis zu übertragen. Durch das Label wird KI-Ethik mess- und operationalisierbar. Das entsprechende Arbeitspapier haben wir im April 2020 veröffentlicht.

Seitdem bereiten wir weitere Praxishilfen für den öffentlichen Sektor vor. Denn dort kommen viele solcher algorithmischen Systeme zum Einsatz, die das Leben Einzelner und der Gesellschaft stark beeinflussen können. Mit einer Handreichung wollen wir bis August 2020 zeigen, wie die Algo.Rules bei der Beschaffung und dem Einsatz algorithmischer Systeme Orientierung bieten können.

Doch auch damit ist der Prozess nicht abgeschlossen: Wir laden Interessierte dazu ein, die Algo.Rules gemeinsam mit uns weiter zu gestalten, sie zu übernehmen, anzupassen, zu erweitern und vor allem Wege zu finden, die Regeln tatsächlich zu implementieren. Die Algo.Rules sind und bleiben ein dynamischer Prozess.

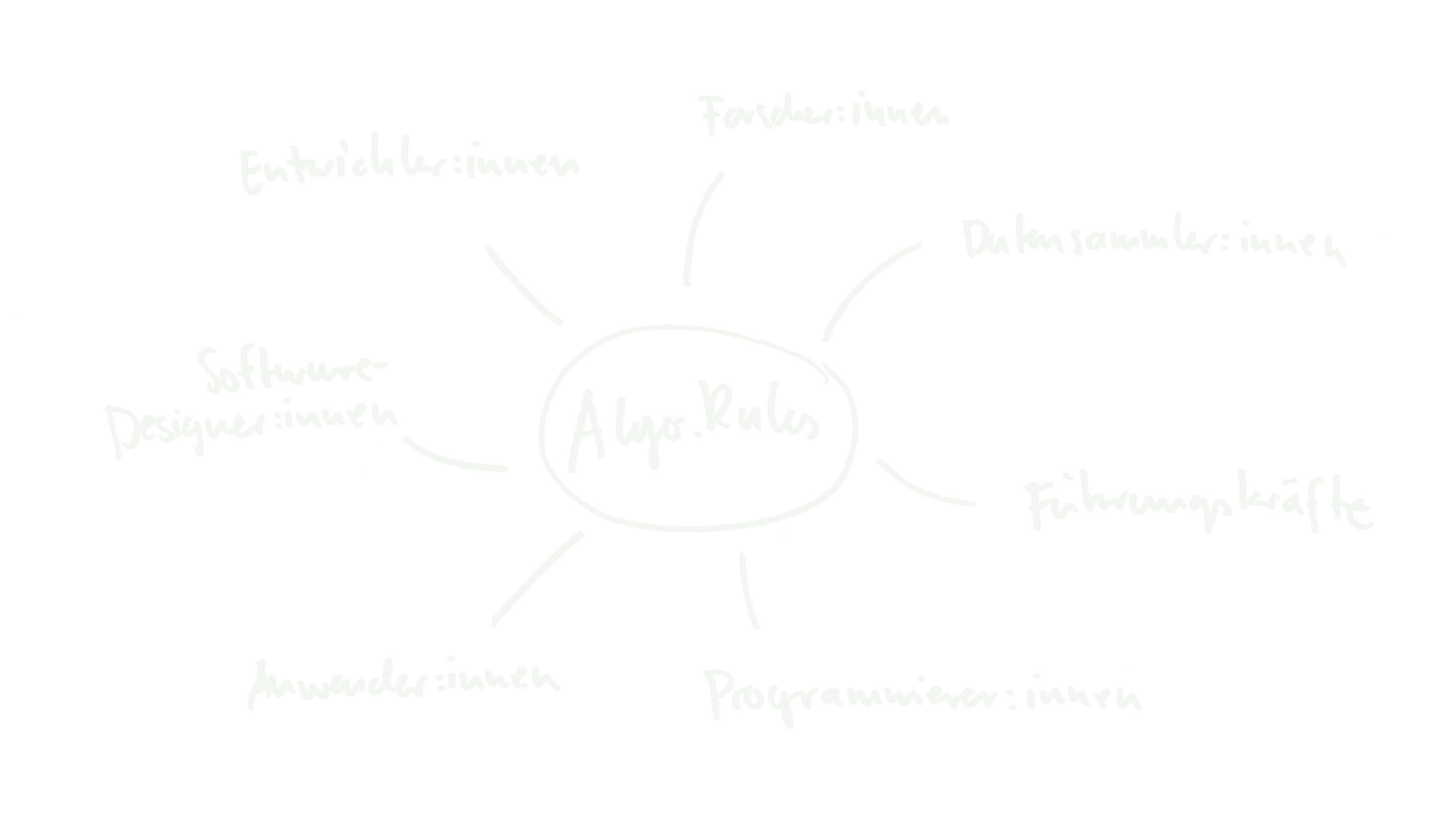

Eine Berufsethik für Programmierer:innen wäre nicht genug. Denn sie sind nicht die einzigen, die entscheidend in den Entwicklungsprozess algorithmischer Systeme involviert sind. Viele andere Berufsgruppen sind ebenso relevant, begonnen bei Führungskräften bis hin zu den Anwender:innen. Wir wollen nicht nur auf den Code des Programms blicken, sondern darauf, wie die Anwendung eingebettet, ausgerichtet und umgesetzt ist. Die Algo.Rules sind am Prozess des algorithmischen Systems orientiert. Das ist eine der Stärken unseres Ansatzes, viele Zielgruppen gemeinsam anzusprechen. Welche Zielgruppen dafür relevant sind, wird hier näher beschrieben.

Die Algo.Rules erheben nicht den Anspruch, auf alle algorithmischen Systeme angewendet zu werden. Sie gelten nur für solche, die einen direkten oder mittelbaren, jedoch immer signifikanten Einfluss auf das Leben der Menschen oder auf die Gesellschaft haben. Dazu zählt beispielsweise Software, die Bewerbungen filtert, Empfehlungen an die Polizei oder Gerichte gibt oder über eine Krankheitsdiagnose entscheidet. Es geht also nicht um Gestaltungsregeln für jedes algorithmische System, sondern nur für solche, die entsprechend relevant sind. Nach welchen Kriterien sich eine solche Relevanzbemessung richten könnte, zeigt beispielhaft die Berechnung des Teilhabewirkungspotentials durch Ben Wagner und Kilian Vieth im Auftrag der Bertelsmann Stiftung: Dieses hängt u.a. davon ab, wer das algorithmische System einsetzt, ob es über Menschen entscheidet, in welchen größeren Prozess und Einsatzbereich das algorithmische System eingebettet ist und welche Konsequenzen die Entscheidung des Systems für das Leben des Einzelnen oder die Gesellschaft hat. Dabei ordnen wir Systeme in unterschiedliche Abstufungen: Je stärker der mögliche Einfluss eines algorithmischen Systems auf das Leben der Menschen oder auf die Gesellschaft ist, desto wichtiger ist die Einhaltung der Algo.Rules und desto genauer sollte dieses System geprüft werden.

Wir haben uns die bestehenden oder in der Erarbeitungsphase befindlichen Prinzipien- und Kriterienkataloge genau angeschaut. Die meisten sind in den USA entwickelt worden. Drei davon haben wir in einer Studie näher analysiert: die „Principles for Accountable Algorithms and a Social Impact Statement for Algorithms“ der FAT/ML-Konferenz, die „Asilomar AI Principles“ des Future of Life Institute sowie die „Principles for Algorithmic Transparency and Accountability“ des ACM US Public Policy Council. Erkenntnisse aus Analysen weiterer Kataloge und dem Austausch mit vielen anderen Projekten flossen ebenso in unsere Arbeit ein. Einen Überblick über die vielen Ansätze liefert das AI Ethics Guidelines Global Inventory. Die Algo.Rules stellen eine Ergänzung und Weiterentwicklung bestehender Initiativen dar. Sie unterschieden sich vor allem in zwei Punkten von anderen Katalogen: Erstens richten sie sich nicht nur an Programmierer:innen, sondern an alle Personen, die an der Entwicklung und dem Einsatz von algorithmischen Systemen beteiligt sind. Zweitens beinhalten sie formale Gestaltungsregeln und keine moralischen Normen, was sie zu einem gewissen Grad universell macht.

Die Algo.Rules sind einem kulturell-europäischen Hintergrund entsprungen, sind jedoch zugleich geprägt von der internationalen Diskussion um die Ethik und wertegeprägte Ausgestaltung algorithmischer Entscheidungssysteme und Anwendungen. Die hier vorliegende Fassung wurde bisher insbesondere von Akteur:innen gestaltet, die in Deutschland aktiv sind. Aber sie richten sich auf eine über die Bundesrepublik hinausgehende Öffentlichkeit und sind deshalb auch in weiteren Sprachen veröffentlicht. Weil die Algo.Rules keine moralischen Normen beinhalten, sind sie zu einem gewissen Grad universell und in unterschiedlichen kulturellen Kontexten einsetzbar.

Die Herausforderung der Algo.Rules besteht, neben der Adressierung einer diversen und breiten Zielgruppe, in ihrer harten Umsetzung. Unsere Analyse hat gezeigt, dass viele der anderen, bestehenden Kriterienkataloge daran gescheitert sind, weil sie entweder nie einen Anspruch auf Implementierung hatten oder ihre Umsetzungsstrategien nicht gefruchtet haben. Genau dafür entwickeln wir konkrete Praxishilfen. Die zielgruppenspezifische Konkretisierung der Algo.Rules für Entwickler:innen und Führungskräfte ist der erste Schritt. Aktuell machen wir die Regeln für den öffentlichen Sektor praktisch anwendbar. Dafür erarbeiten wir eine Handreichung, damit öffentliche Institutionen die Algo.Rules bei der Beschaffung und dem Einsatz algorithmischer Systeme umsetzen können.

Die Algo.Rules sind ein Angebot für die Öffentlichkeit und ein möglicher Startpunkt für viele relevante Prozesse. Der Leitfaden für Entwickler:innen und das Impulspapier für Führungskräfte zeigen, was die Algo.Rules zielgruppenspezifisch bedeuten. Wichtige Schritte sind damit getan. Der nächste und wichtigste Schritt ist, die konkrete Umsetzung. Dafür werden wir uns auf den öffentlichen Sektor konzentrieren. Ob vorausschauende Polizeiarbeit, die automatische Bearbeitung von Sozialhilfeanträgen oder das Sortieren von Arbeitslosen – einige der besonders stark diskutierten algorithmischen Systeme kommen aus dem öffentlichen Sektor. Systeme, die dort eingesetzt werden, haben tendenziell auch einen großen Einfluss auf das Leben Einzelner oder auf die Gesellschaft. Daher ist es dort besonders wichtig, mit den Algo.Rules eine Grundlage für ethische Erwägungen und für die Um- und Durchsetzung rechtlicher Rahmenbedingungen zu schaffen. Dafür analysieren wir verschiedene Fallbeispiele sowie den Prozess der öffentlichen Beschaffung und des Einsatzes algorithmischer Systeme. Wir konsultieren und befragen Expert:innen aus dem öffentlichen Sektor. Ziel ist es, die Algo.Rules für die Praxis relevant zu machen und Vorschläge für Implementierungsmaßnahmen zu entwickeln.

Die Algo.Rules bleiben auch darüber hinaus ein Angebot: Wer mit uns die Algo.Rules spezifizieren möchte oder eine Idee hat, anhand welcher Anwendung man die Umsetzung der Algo.Rules testen könnte, kann sich über unser Kontaktformular bei uns melden.